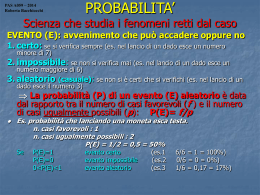

Prof. Ciro Incontro Premessa Eventi Definizione classica di probabilità I valori della probabilità Insiemi ed eventi Evento unione Evento intersezione Teorema della probabilità dell’evento contrario Teorema della Probabilità Totale (eventi incompatibili) Teorema della Probabilità Totale (eventi compatibili) Teorema della Probabilità Condizionata Teorema della Probabilità Composta (eventi indipendenti) Teorema della Probabilità Composta (eventi dipendenti) Calcolo delle Probabilità Il calcolo delle probabilità nacque dagli studi dei matematici sui giochi d’azzardo. Il primo a interessarsi della ricerca di una legge che regolasse il gioco con i dadi fu Blaise Pascal. In questo campo si distinsero anche Eulero, Fermat e Bernoulli. Bisogna attendere però fino ai primi del XIX secolo, con Laplace, affinchè nel mondo matematico assuma importanza il calcolo delle probabilità, che Laplace riconobbe come un vero e proprio strumento scientifico. Le sue idee trovarono la più ampia conferma nel XX secolo con i grandi progressi realizzati in fisica quantistica. Il calcolo delle probabilità si interessa di tutti quei fenomeni il cui verificarsi dipende esclusivamente dal caso. Si tratta dei cosiddetti fenomeni incerti, i quali non sono né certi né impossibili, ma qualcosa che si colloca fra gli uni e gli altri. Il calcolo delle probabilità è quindi uno strumento che consente all’uomo di assumere un comportamento razionale di fronte all’incertezza. Le definizioni di probabilità. Dagli studi intrapresi dai matematici sui giochi d’azzardo ha origine, all’inizio dell’800, la prima definizione di probabilità, denominata classica. In seguito si ebbero la definizione frequentista, quella soggettiva e, per ultima, quella assiomatica, dovuta principalmente a Kolmogorov. È interessante osservare che tutte queste definizioni si basano sul concetto di evento. Evento. Per evento si intende qualsiasi fatto o avvenimento che può essere osservato. Ci sono avvenimenti che accadono con certezza, mentre altri sicuramente non possono mai verificarsi. Ci sono anche eventi che possono accadere, ma senza certezza. Un evento si dice certo se si verifica sempre. Per esempio, se da una scatola, che contiene soltanto palline nere, se ne estrae una a caso, siamo sicuri che essa è nera. Questo è un evento certo. Un evento si dice impossibile se non si verifica mai. Per esempio, l’estrazione di una pallina nera da una scatola che contiene solo palline bianche è un evento impossibile. Un evento si dice incerto se si verifica oppure no. Per esempio, la vittoria di un atleta in una gara è un evento incerto, in quanto l’atleta può vincere o no. Altro esempio. Se una scatola contiene palline bianche e nere, l’estrazione di una pallina nera è un evento possibile ma non certo, cosi come l’estrazione di una pallina bianca. In altre parole, non possiamo prevedere il colore della pallina estratta, perché l’estrazione è casuale. Altri esempi: E1 = « nel lancio di un dado esce il 4 » E2 = « nel lancio di una moneta esce croce » La realizzazione di questi eventi dipende essenzialmente dal caso e, per questo motivo, essi sono chiamati eventi casuali o aleatori. Si noti che uno stesso evento può essere certo, impossibile o aleatorio a seconda del contesto in cui viene considerato. Esempio. L’evento « Maria vince alla lotteria » è certo se Maria compra tutti i biglietti della lotteria, è impossibile se non ne compra nemmeno uno, è aleatorio se ne compra uno o più di uno, ma non tutti. Eventi composti. Dati due eventi E1 e E2 possiamo ottenere un evento composto mediante i connettivi logici ”e” e ”o” ; oppure dato un evento E è possibile ottenere la sua negazione (connettivo logico ”non”) come l’evento che si verifica se non si verifica E. La negazione dell’evento E si indica con E (si legge E negato). A titolo di esempio sono eventi semplici: E1 = « uscita di croce nel lancio di una moneta » E2 = « uscita del 4 nel lancio di un dado » E3 = « uscita di un numero dispari nel lancio di un dado » sono invece eventi composti: E2 E3 = « uscita del 4 o di un numero dispari nel lancio di un dado » E1 = « uscita di testa nel lancio di una moneta » Evento contrario. Dato un evento E, il suo evento contrario è quell’evento che si verifica quando e solo quando non si verifica E, e lo indichiamo con il simbolo E . Esempio. Un mazzo di carte contiene carte con figure e carte senza figure. L’evento E1 = « estrazione di una carta con figura » ha come evento contrario E2 = «estrazione di una carta senza figura » cioè E 2 E1 . Esempio. Nel lancio di una moneta , l’evento contrario dell’uscita testa è l’uscita croce. Esempio. Nel lancio di un dado, l’evento contrario dell’uscita di un numero pari è l’uscita di un numero dispari. Eventi incompatibili. Due eventi E1 e E2 sono incompatibili se il verificarsi di uno esclude il verificarsi contemporaneo dell’altro. In caso contrario i due eventi si dicono compatibili. Esempio. Si considerano tre eventi che indichiamo con P, B, R e che corrispondono ai possibili esiti di un anno scolastico per uno studente e cioè: P = «promosso», B = «bocciato», R = «rimandato». Ciascuno di essi è incompatibile con gli altri due in quanto il verificarsi di uno di essi esclude il verificarsi degli altri due. Esempio. Si supponga di estrarre, da un mazzo di carte, una carta. Gli eventi E1 = « estrazione di una carta del segno di fiori » E2 = « estrazione di una figura » sono eventi compatibili, in quanto è possibile estrarre una figura del segno di fiori. Eventi indipendenti. Due eventi E1 e E2 sono indipendenti se il verificarsi di uno dei due non influenza il verificarsi dell’altro. In caso contrario i due eventi si dicono dipendenti. Esempio. Si consideri il gioco della roulette. Gli eventi: E1=«uscita di un numero nero» E2=«uscita di un numero dispari» sono indipendenti, perché il verificarsi dell’uno non influisce sul verificarsi dell’altro. La definizione classica di probabilità. In molti problemi legati all’estrazione da un’urna contenente palline colorate, è possibile calcolare a priori quali e quanti casi possano realizzarsi e quali e quanti casi si possono considerare favorevoli all’esito dell’esperimento. È quindi possibile conoscere a priori il numero dei casi favorevoli f e quello dei casi possibili n. Secondo la definizione di Laplace: « La probabilità p di un evento E, che indichiamo con il simbolo pE , è uguale al rapporto fra il numero dei casi favorevoli all’evento E e il numero dei casi possibili, ammesso che tutti siano egualmente possibili ». Cioè: p E f n Definizione di Laplace con f = numero dei casi favorevoli n = numero dei casi possibili Esempio. Si calcoli la probabilità che lanciando una moneta esca croce. I casi possibili n sono due (testa e croce), il caso favorevole f è uno (croce). 1 Si ha: p 2 Esempio. Si determini la probabilità che nel lancio di un dado: E1 = « esce il 4 » E2 = « esce un numero dispari » E3 = « esce un numero maggiore di 2 » Calcoliamo la probabilità di ciascun evento nell’ipotesi che il dado non sia truccato: pE1 1 6 (casi possibili n 6 , casi favorevoli f 1 ) p E 2 3 1 6 2 (casi possibili n 6 , casi favorevoli f 3 cioè 1, 3, 5) p E 3 4 2 6 3 (casi possibili n 6 , casi favorevoli f 4 cioè 3, 4, 5, 6) I valori della probabilità. Si è detto che n rappresenta il numero dei casi possibili ed f il numero dei casi favorevoli. f 0 Se un evento è impossibile, il numero dei casi favorevoli è 0; quindi: p 0 n n la probabilità di un evento impossibile è uguale a 0. Se un evento è certo, il numero dei casi favorevoli è uguale a quello dei casi possibili; f n p 1 quindi: n n la probabilità di un evento certo è uguale a 1. Per gli eventi aleatori, il numero dei casi favorevoli f è compreso fra 0 e n: 0 f n 0 f n 0 p 1 n n n la probabilità di un evento aleatorio è un numero compreso fra 0 e 1. In generale, considerando assieme i tre casi, possiamo dire che la probabilità di evento è compresa fra 0 e 1, estremi inclusi: 0 p 1 Spesso il valore della probabilità viene espresso in termini percentuali. Per esempio, un evento certo si verificherà al 100%. Insiemi ed eventi. Consideriamo il lancio di un dado e l’evento: E = « esce un numero dispari » Per descrivere la situazione possiamo utilizzare il linguaggio degli insiemi. Tutti gli eventi possibili sono 6 e si possono considerare come elementi di un insieme, che si indica con U, denominato “Insieme Universo” degli eventi, e cioè: U F 2 1 5 U 1 , 2 , 3 , 4 , 5 , 6 4 3 6 Gli eventi favorevoli sono tre (i numeri 1, 3, 5) e possono essere considerati elementi di un insieme F, sottoinsieme di U. Poiché F è un sottoinsieme di U, il numero degli elementi di F è sempre minore o uguale al numero degli elementi di U. Se l’insieme F non ha elementi, cioè F Φ, allora l’evento è impossibile; se F coincide con l’insieme universo U, allora l’evento è certo. Evento Unione. Definizione. Dati gli eventi E1 e E2 , relativi allo stesso insieme universo, il loro evento unione, che indichiamo con E1 E2 , è quell’evento che si verifica al verificarsi di almeno uno degli eventi dati. U A1 E1 E2 A2 Consideriamo 1 2 dischetti numerati da 1 a 12 e gli eventi: E1 = « estrazione di un numero pari » E2 = « estrazione di un numero maggiore di 7 » L’insieme dei casi favorevoli a E1 è: A1 2 , 4 , 6 , 8 , 10 , 12 L’insieme dei casi favorevoli a E2 è: A2 8 , 9 , 10 , 11 , 12 Consideriamo i 12 dischetti numerati, l’evento: E = « esce un numero pari o maggiore di 7 » è formato da due eventi semplici E1 ed E2 , uniti dal connettivo ”o”. Questo particolare evento si verifica se esce un numero pari oppure se esce un numero maggiore di 7, perciò è detto Evento Unione o Somma Logica di E1 ed E2 . Nell’esempio considerato l’evento E ha come casi favorevoli sia quelli dell’insieme A1 sia quelli dell’insieme A2 . L’insieme che lo rappresenta è quindi l’unione dei due insiemi: A1 A2 2 , 4 , 6 , 8 , 9 , 10 , 11 , 12 A1 2 6 1 5 3 4 8 U 10 12 7 11 9 A2 Nella figura, A1 è l’insieme dei casi favorevoli a E1 , A2 quello dei casi favorevoli a E2 . Allora A1 A2 è l’insieme dei casi favorevoli a E1 E2 . Evento intersezione. Definizione. Dati gli eventi E1 e E2 , relativi allo stesso insieme universo, il loro evento intersezione, che indichiamo con E1 E2 , è quell’evento che si verifica quando si verificano contemporaneamente gli eventi dati. E1 E2 U A1 A2 Consideriamo ancora i 12 dischetti numerati e l’evento: E = « esce un numero pari e maggiore di 7 » Formato dai due eventi semplici E1 ed E2 uniti dal connettivo ”e”: E1 = « estrazione di un numero pari » E2 = « estrazione di un numero maggiore di 7 » L’evento E si verifica se si verificano entrambi gli eventi E1 ed E2 , perciò è detto Evento Intersezione o Prodotto Logico di E1 ed E2 . Esso ha come casi favorevoli quelli comuni all’insieme A1 e all’insieme A2. L’insieme che lo rappresenta è l’insieme intersezione: A1 2 6 1 5 8 U 3 4 10 12 7 11 9 A1 A2 8 , 10 , 12 A2 Nella figura, A1 è l’insieme dei casi favorevoli a E1 , A2 quello dei casi favorevoli a E2 . Allora A1 A2 è l’insieme dei casi favorevoli a E1 E2 . Osservazione. Nonostante la notazione insiemistica, E1 E2 ed intersezione di insiemi. E1 E2 non sono unione e TEOREMI SULLA PROBABILITÀ. Teorema della probabilità dell’evento contrario. Il teorema della probabilità dell’evento contrario può venire enunciato come segue: L’evento contrario di un evento E ha probabilità p E 1 p E Si può anche dire che: La probabilità dell’evento E , contrario all’evento E, è il complemento a 1 della probabilità dell’evento E. Dimostrazione. Se f è il numero di casi favorevoli dell’evento E ed n il numero dei casi possibili, il numero dei casi favorevoli dell’evento contrario è n – f , quindi si ha: p E n f n f 1 p E n n n Questo teorema può essere riformulato nel seguente modo: La somma delle probabilità di un evento E e del suo contrario E è uguale a 1: p E p E 1 Esempio 1. Si determini la probabilità di un evento E, sapendo che il suo contrario E ha probabilità p E 2 7 La probabilità di E è data da: p E 1 p E 1 2 72 5 7 7 7 Esempio 2. Si calcoli la probabilità che lanciando contemporaneamente 4 monete si presenti almeno una testa. Il problema si può risolvere applicando il teorema dell’evento contrario. Alla probabilità dell’evento certo (che vale 1) si toglie la probabilità che si verifichino 4 croci: 1 p E 2 4 In questo modo si ricava: 1 16 1 15 1 p E 1 p E 1 1 16 16 16 2 4 Teorema della Probabilità Totale. Teorema della somma per eventi incompatibili. Dati due eventi E1 e E2 incompatibili, la probabilità dell’evento unione E1 E2 è data dalla somma delle probabilità dei singoli eventi: p E1 E2 p E1 p E2 Riprendiamo l’esempio dei 12 dischetti numerati e consideriamo i due eventi incompatibili: E1 = « estrazione di un multiplo di 5 » E2 = « estrazione di un multiplo di 3 » Cerchiamo la probabilità dell’evento unione: E = « esce un numero multiplo di 5 o di 3 » I casi favorevoli di E1 sono 2, quelli di E2 sono 4. Pertanto i casi favorevoli di E sono 6, mentre i casi possibili sono 12. La probabilità dell’evento E è uguale alla somma delle due probabilità: 2 4 6 1 p E p E1 E2 p E1 p E2 12 12 12 2 Esempio. Un’urna contiene 6 gettoni neri, 5 rossi e 4 bianchi. Estraendo a caso un gettone si può verificare uno dei seguenti eventi: E1 = « estrazione di un gettone nero » E2 = « estrazione di un gettone rosso » E3 = « estrazione di un gettone bianco » Le probabilità sono: p E1 6 2 15 5 p E 2 5 1 15 3 Calcoliamo ora la probabilità degli eventi: E4 = « estrazione di un gettone nero o rosso » E5 = « estrazione di un gettone rosso o bianco » E6 = « estrazione di un gettone nero o rosso o bianco » p E 4 2 1 6 5 11 5 3 15 15 p E5 1 4 5 4 9 3 3 15 15 15 5 p E6 2 1 4 6 5 4 15 1 5 3 15 15 15 p E3 4 15 Teorema della somma per eventi compatibili. Se due eventi E1 e E2 sono compatibili, la probabilità del loro evento unione E1 E2 è uguale alla somma delle loro probabilità, diminuita della probabilità del loro evento intersezione: p E1 E2 p E1 p E2 p E1 E2 Consideriamo i 12 dischetti numerati e i seguenti eventi compatibili: E1 = « estrazione di un numero pari » E2 = « estrazione di un numero maggiore di 7 » I casi favorevoli di E1 sono 6, quelli di E2 sono 5. I casi favorevoli dell’evento composto: E = « estrazione di un numero pari o maggiore di 7 » non sono 11 ma solo 8. Ciò è dovuto al fatto che vi sono casi favorevoli a entrambi gli eventi. Se sommiamo i casi favorevoli di E1 e quelli di E2 ,vengono considerati per due volte i casi di E1 E2 , mentre nell’unione essi devono essere contati una sola volta. Possiamo concludere che i casi favorevoli di E1 E2 (eventi compatibili) si possono ottenere dalla somma di quelli di E1 e quelli di E2 , sottraendo quelli di E1 E2 , cioè: 6 5 3 8 p E p E1 E2 6 5 3 12 6 5 3 8 2 12 12 12 12 3 p E1 p E2 p E1 E2 Esempio. Dentro un’urna vi sono 30 palline: 10 bianche numerate da 1 a 10, 10 rosse e 10 gialle numerate allo stesso modo. Calcoliamo la probabilità che, estraendone una a caso, venga estratta una pallina gialla o pari. Il numero totale di palline è 30. La probabilità che venga estratta una gialla è p EG 10 1 30 3 Le palline con numero pari sono 5 per ogni colore, quindi 15. La probabilità che venga 15 1 estratto un numero pari è p E P 30 2 Gli eventi sono compatibili; i casi favorevoli a entrambi gli eventi (pallina gialla e pari) sono 5. La probabilità dell’evento cercato è: p G P p G p P p G P 1 1 5 1 1 1 2 3 1 4 2 3 2 30 3 2 6 6 6 3 Teorema della Probabilità Condizionata. Come si determina la probabilità di un evento che dipende da un altro evento? Esempio. Consideriamo il sacchetto con i gettoni numerati da 1 a 12 e i due eventi: E1 = « esce un multiplo di 3 » E2 = « esce un numero minore di 9 » L’insieme universo (casi possibili) è dato da U 1, 2 , 3, 4 , 5 , 6 , 7 , 8 , 9 ,10 ,11,12 quello dei risultati favorevoli a E1 è A 3, 6 , 9 ,12 quello dei risultati favorevoli a E2 è B 1, 2 , 3, 4 , 5 , 6 , 7 , 8 4 1 La probabilità di E1 è: p E1 12 3 Supponiamo che un amico estragga un numero e, senza farcelo vedere, ci dica che esso è minore di 9, ossia che si è verificato l’evento E2. Cosa si può dire della probabilità che il numero estratto sia multiplo di 3, ossia di p E1 ? L’evento E1 è condizionato dall’evento E2: il fatto che E2 si sia verificato ci dà alcune informazioni in più sulla probabilità che si verifichi E1. Indichiamo la probabilità di E1, calcolata nell’ipotesi che E2 si sia verificato, con il simbolo p E1 / E2 . Chiameremo p E1 / E2 “probabilità dell’evento E1 condizionata dall’evento E2”. Per calcolare la probabilità condizionata teniamo presente che: poiché supponiamo che l’evento E2 si sia verificato, l’insieme universo U’ per E1 / E2 è dato dai risultati favorevoli a E2 , cioè U ' B 1, 2 , 3 , 4 , 5 , 6 , 7 , 8 i casi favorevoli devono essere ricercati solo all’interno del nuovo insieme universo; quindi sono dati dall’intersezione tra i casi favorevoli per E1 (insieme A) e quelli per E2 (insieme B). L’insieme F dei casi favorevoli è dato da F A B 3, 6 Dunque p E1 / E2 è data dal rapporto tra il numero casi favorevoli U di elementi di F e il numero di elementi di U’ : p E1 E2 2 1 p E1 / E2 p E 2 8 4 1 La probabilità di E1 è p E1 , mentre quella di E1 3 1 condizionata a E2 è p E1 / E2 quindi: 4 p E1 p E1 / E2 B=U’ A 9 12 2 6 4 1 5 3 7 8 10 11 A B casi possibili Esempio. Consideriamo un altro caso con i due eventi: E1 = « esce un multiplo di 3 » E3 = « esce un numero pari » Supponiamo che il nostro amico ci dica che ha estratto un numero pari, ossia che si è verificato l’evento E3 rappresentato dall’insieme C 2 , 4 , 6 , 8 ,10 ,12 Se si è verificato l’evento E3 , i casi possibili che il numero uscito sia multiplo di 3, cioè dell’evento E1 condizionato dall’evento E3 , sono 6 e quelli favorevoli 2 , cioè quelli dell’insieme A C 6 ,12 casi favorevoli La probabilità di E1 condizionata a E3 è: p E1 / E3 p E1 E3 2 1 p E3 6 3 U A La probabilità di E1 è p E1 1 , e quella di E1 3 1 condizionata a E3 è p E1 / E 2 quindi: 3 p E1 p E1 / E3 C 3 6 12 9 7 5 2 10 4 8 11 A C 1 casi possibili Due eventi, E1 ed E2 si dicono dipendenti se p E1 è diversa dalla probabilità condizionata p E1 / E2 . Gli eventi E1 ed E2 si dicono indipendenti se p E1 è uguale alla probabilità condizionata p E1 / E2 . Dati due eventi E1 e E2 , la probabilità che si verifichi l’evento E1 condizionato alla realizzazione dell’evento E2 è data dal rapporto tra la probabilità dell’evento intersezione di E1 ed E2 e la probabilità dell’evento E2. p E1 / E2 p E1 E2 p E2 Analogamente. Dati due eventi E1 e E2 , la probabilità che si verifichi l’evento E2 condizionato alla realizzazione dell’evento E1 è data dal rapporto tra la probabilità dell’evento intersezione di E1 ed E2 e la probabilità dell’evento E1. p E2 / E1 p E1 E2 p E1 Esempio. Si lanci una coppia di dadi: se la somma è 6, si determini la probabilità che uno dei due dadi abbia dato esito 2. Si tratta di determinare la probabilità di avere per somma 6, subordinata al fatto che su una delle due facce sia presente il numero 2. Consideriamo i due eventi: E1 = « uscita faccia con il numero 2 » E2 = « la somma dei punti delle facce è 6 » Poiché i casi possibili sono 36 e 11 sono le coppie che contengono almeno un 2, si ha: p E1 11 36 Le coppie che contengono un 2 e hanno come somma 6 sono 2 (infatti sono (2,4) e (4,2) ), secondo dado mentre i casi possibili sono ancora 36. 2 Quindi: p E1 E2 6 36 5 In conclusione si ha: 2 p E1 E2 36 2 36 2 p E2 / E1 11 p E1 36 11 11 36 4 3 2 1 1 2 3 4 5 6 primo dado Teorema della Probabilità Composta. Teorema del prodotto per eventi indipendenti. Se due eventi E1 e E2 sono indipendenti, la probabilità del loro evento intersezione E1 E2 è uguale al prodotto delle loro probabilità. p E1 E2 p E1 p E2 La probabilità dell’evento intersezione è denominata “probabilità composta”. Consideriamo un sacchetto che contiene tre gettoni con i numeri 1, 2, 3. Dal sacchetto estraiamo un gettone e poi un secondo gettone, dopo che il primo è stato rimesso nel sacchetto. seconda estrazione Qual è la probabilità che in due estrazioni successive vengano estratti due numeri dispari? I casi possibili si possono ottenere mediante il seguente 3 diagramma cartesiano. 2 Per esempio la coppia (3,2) indica che è stato estratto prima il gettone 3 e poi il gettone 2. 1 (1,3) (2,3) (3,3) (1,2) (2,2) (3,2) (1,1) (2,1) (3,1) 1 2 3 prima estrazione L’evento composto E = « estrazione di due numeri dispari » può essere visto come l’evento intersezione dei due eventi semplici: E1 = « il primo numero è dispari » E2 = « il secondo numero è dispari » E1 ed E2 sono indipendenti, infatti, dopo la prima estrazione, il gettone è rimesso nel sacchetto e la situazione iniziale viene ripristinata. Poiché i numeri dispari sono 2 e i casi possibili 3, la probabilità di E1 ed E2 è data da: p E1 2 3 p E2 2 3 I casi favorevoli all’evento E corrispondono alle coppie (1;1), (1:3), (3;1), (3;3) quindi sono 4. I casi possibili sono 9 (come si può vedere nel diagramma cartesiano), quindi si ha: 2 2 4 p E p E1 p E2 3 3 9 che è la probabilità dell’evento intersezione di E1 ed E2. Altro esempio. Due urne contengono: Urna 1 : 5 palline bianche e 5 nere Urna 2 : 8 palline bianche e 4 nere Viene estratta una pallina da ogni urna. Qual è la prababilità che siano entrambe nere? L’evento E = « vengono estratte due palline nere » è composto dai due eventi semplici: E1 = « viene estratta una pallina nera dall’urna 1 » E2 = « viene estratta una pallina nera dall’urna 2 » Si ha: p E1 5 1 10 2 p E 2 4 1 12 3 Gli eventi sono indipendenti; quindi la probabilità dell’evento intersezione è: 1 1 1 p E1 E2 p E1 p E2 2 3 6 Teorema del prodotto per eventi dipendenti. Se due eventi E1 e E2 sono dipendenti, la probabilità del loro evento intersezione E1 E2 è uguale al prodotto della probabilità di E1 per la probabilità di E2 condizionata a E1. p E1 E2 p E1 p E2 / E1 Consideriamo ancora il sacchetto con tre gettoni che hanno i numeri 1, 2, 3 e gli eventi: E1 = « il primo numero è dispari » e E2 = « il secondo numero è dispari » ma supponiamo che, dopo la prima estrazione, il gettone non venga rimesso nel sacchetto. Gli eventi sono dipendenti: infatti, la probabilità del secondo evento non è più quella di prima, perché la composizione iniziale nel sacchetto risulta modificata. I due eventi semplici non hanno lo stesso insieme universo (casi possibili): nella prima estrazione U contiene 3 elementi, nella seconda ne contiene 2. Calcoliamo la probabilità condizionata p E2 / E1 , ossia la probabilità che si abbia E 2 supposto che sia avvenuto E1. Se si è verificato E1 significa che è stato estratto un numero dispari; quindi nel sacchetto rimangono due gettoni: il 2 e l’altro numero dispari. La probabilità di estrarre un numero dispari (evento E1) è p E1 2 3 mentre la probabilità condizionata di estrarre un altro numero dispari è p E2 / E1 1 2 Calcoliamo, ora, la probabilità dell’evento composto: E = « i numeri estratti sono entrambi dispari » La probabilità di E si ottiene applicando il Teorema del prodotto per eventi dipendenti, cioè moltiplicando la probabilità di E1 per la probabilità di E2 condizionata a E1. Quindi: 2 1 2 1 p E1 E2 p E1 p E2 / E1 3 2 6 3 I casi possibili sono 6. I casi favorevoli sono 2, corrispondenti alle coppie (1;3) e (3;1). Altro esempio. In un’urna ci sono 8 palline bianche e 4 nere (fig. 1). Qual è la probabilità che, estraendo contemporaneamente due palline, esse siano entrambe bianche? Si può estrarre prima una pallina e poi, senza rimettere la prima nell’urna, una seconda pallina. 8 2 La probabilità che la prima sia bianca è: p E1 12 3 La probabilità che la seconda sia bianca, condizionata dal fatto che la prima estratta sia bianca, si ottiene pensando a un’urna che contiene 7 palline bianche e 4 nere (fig. 2): fig. 1 Situazione iniziale p E2 / E1 7 11 La probabilità che entrambe le palline siano bianche è: 2 7 14 p E p E1 p E2 / E1 3 11 33 fig. 2 Situazione dopo la prima estrazione

Scaricare