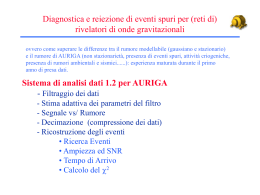

Filtri adattativi FILTRI ADATTATIVI Progetto di filtri FA-1 Sintesi della funzione di trasferimento del filtro Adattamento Un filtro adattativo e’ simile ad una rete neurale lineare MA I parametri del filtro sono continuamente cambiati secondo un criterio predefinito (di ottimizzazione), senza un esplicito controllo dell’utilizzatore (MEMORIA A BREVE TERMINE) La rete neurale non si addestra più dopo il training (MEMORIA A LUNGO TERMINE) COMBINATORE LINEARE ADATTATIVO x(n) D 1 y (n) wi x (n i ) FA-2 z-1 w0 w1 y(n) z-1 w2 S i 0 Criterio di progetto (sintesi) z-1 wi = ? wD-1 Linea di ritardo Risposta desiderata d(n) (filtro adattativo) x(n) H(z) y(n) + d(n) - (n) CRITERIO Regressore lineare (senza bias) dalla serie in ingresso alla serie desiderata, di ordine D. FA-3 FILTRO OTTIMO x(n) w? y(n) + d(n) - (n) 1 MSE= J = <2(n) 2 > funzione costo (n)=d(n)-y(n) J 0 wk k = 0,..., D - 1 F G H IJ K J 1 1 2 ( n) d ( n) y ( n) wk wk 2 2 wk b g F I y (n) b d ( n) y ( n) g G d (n) w x (n i )Jx (n k ) H K w D 1 i k i 0 2 R U d ( n) x ( n k ) S w x(n i ) x(n k )V T W FA-4 D 1 i i 0 D 1 p(n, n k ) wi R(n i , n k ) i 0 Equazioni di Wiener-Hopf con R(n i , n k ) x (n i ) x (n k ) Funzione di autocorrelazione nel tempo p(n, n k ) d (n) x (n k ) Funzione di cross-correlazione nel tempo J 0 wk D-1 R(n -i, n k ) p(n, n k ) FA-5 i =0 Con notazione vettoriale: J 0 Rw p w Con: L x ( n) x (n) x (n 1) .. x (n) x (n D 1) O M P x ( n 1 ) x ( n ) x ( n 1 ) x ( n 1 ) .. x ( n 1 ) x ( n D 1 ) M P M . P . . . M P . . . . M P M Nx(n D 1) x(n) x(n D 1) x(n 2) . x(n D 1) P Q 2 R x x T 2 p d (n) x (n) [d (n) x (n) ... d (n) x (n D 1)]T IL PRINCIPIO DI ORTOGONALITÀ 1 J < 2 (n) > 2 J 0 wk D -1 y (n) = wi x (n i ) ( n) = d ( n) - y ( n) i =0 < (n) x (n - k ) >= 0 FA-6 k 0,..., D 1 Errore ortogonale all’ingresso D -1 < (n) y (n) >=< (n) wk x (n k ) >= i =0 D -1 = wk (n) x (n k ) >= 0 i =0 Errore ortogonale all’uscita LA SOLUZIONE DI WIENER FA-7 d(n) e(n) < (n) x (n - k ) >= 0 < (n) y(n) >= 0 x(n-D+1) w x(n) L’uscita del filtro è la proiezione del segnale desiderato nello spazio degli ingressi La soluzione di Wiener per la minimizzazione di J è analitica e richiede l’inversione della matrice di correlazione (alto costo computazionale) w = R-1p LA SOLUZIONE ITERATIVA FA-8 J 1 < 2 (n) > 2 ( n) = d ( n) - y ( n) = d ( n) - w T x Minimizzare il funzionale J Es: D=2 1 1 T T T < d 2 (n) > + w < x x w w < xd (n) 2 2 w(1) 1 1 T T 2 d (n) + w Rw w p 2 n 2 J Forma quadratica w = wottimo 2-D Jmin w(2) wottimo Paraboloide J = Jminimo n indice iterazione wn+1= wn- pn taglia dello step pn direzione della ricerca LMS FA-9 1 2 ( n) p n J n wn 1 wn J n 2 wn J 1 2 ( n) J n wn 2 wn R Rn; g gn Alto costo computazionale Stima di Widrow e Stearns (Least Mean Square - LMS) 2 J 1 ( n) J n wn 2 wn Aggiornamento iterativo derivato dal considerare il solo valore istantaneo dell’errore FA-10 2 J 1 ( n) 1 (n) ( d ( n ) w n x n ) Jn 2 (n) ( n) wn 2 wn 2 wn wn T (n) x(n) w(n 1) w(n) (n) x(n) •Non richiede l’inversione di matrici •Non richiede il calcolo di R e p IL FILTRO DI WIENER COME APPROSSIMATORE DI FUNZIONI FA-11 •x(n) •d(n)=f(x(n)) Il filtro deve trovare un’approssimazione lineare di f(.) •Dati temporali approssimazione nello spazio del segnale Il combinatore lineare effettua una regressione nello spazio del segnale •Le basi dello spazio del segnale sono l’ingresso e i campioni ritardati PROPRIETA’ DELLA SOLUZIONE ITERATIVA max 2 max max Taglia dello step Massimo max 2 min min autovalore di R Nella pratica: 0 1 tr ( R) 0 0.01 01 . N (Potenza del tr ( R) x 2 (n i ) segnale ai i 0 taps) R definisce la proprietà dell’algoritmo di learning FA-12 Costante di tempo Minimo autovalore di R APPLICAZIONI FA-13

Scaricare