Calcolo delle Probabilità

Introduzione

Fenomeno deterministico: se

l’esperimento è condotto nelle

stesse condizioni si trova lo

stesso risultato

Esempi:

•Moto di un grave

•Traiettoria di una pallina in

un biliardo

Fenomeno non deterministico:

anche se gli esperimenti sono

condotti nelle stesse condizioni

si trovano risultati diversi

Esempi:

•Risultato del lancio di una

moneta

•Traiettoria di 100 palline in un

biliardo

•Vincita in una lotteria

•Numero di lanci di un dado per

ottenere un 6

La probabilità si occupa di fenomeni non deterministici

Esperiment o aleat orio:

i singoli esiti d ell’esperim ento non sono pred icibili con

esattezza.

Esem pio. Se l'esperim ento consiste nel lancio d i u na

m oneta, non è possibile stabilire con certezza se l'esito d i

u n singolo lancio sarà testa o croce.

Eventi: chiamiamo evento l’insieme costituito d a uno

o più d ei possibili risultati o esiti d i un esperimento

aleatorio.

Esem pio. N el caso d ell’esperim ento costitu ito d al lancio

d i u n d ad o p ossono essere osservati i segu enti eventi.

A : “si osserva u n nu m ero d ispari”;

B: “si osserva u n nu m ero m inore d i 3”;

Ei: “si osserva il nu m ero i, con i = 1, 2, …, 6”.

Spazio campione:

Insieme S di tutti i risultati dell’esperimento

Esempio:

•Nel caso del lancio di una moneta S={Testa, Croce}

•Nel caso dei numeri di lanci di un dado necessari per avere 6

S=N (numeri naturali)

S = {E1, E2, E3, E4, E5, E6}

E1

E5

E3

E6

E2

E4

Gli eventi possono essere d ivisi in d ue classi:

semplici e composti.

Gli eventi semplici sono costituiti da uno solo dei possibili

risultati di un esperimento aleatorio.

Gli eventi composti sono costituiti da da più di uno dei possibili

risultati di un esperimento aleatorio.

Un evento composto può sempre essere scomposto in eventi

semplici. Se un evento non risulta ulteriormente scomponibile

è per definizione un evento semplice.

Fenomeno casuale

Evento elementare

Spazio Campionario

1

Evento

n

N

Un qualsiasi sottoinsieme dello spazio

campionario, ovvero un insieme di eventi

elementari

E 1 , n

E

Si usa dire che l’evento E si è realizzato se il

fenomeno si manifesta con uno degli eventi

elementari che appartengono ad E

Lancio di un dado

E=

E

Faccia “pari”

,

Si realizza se viene faccia 3 o faccia 6

A=

Modi di descrivere l’evento

Faccia “dispari”

B=

,

,

,

,

N el caso d ell'esperim ento consistente nel m isu rare, con

u no stru m ento infinitam ente preciso, il livello d i piovosità

in una certa area geografica, lo spazio cam pione è

S = {E1, E2, ...}

perché, all'interno d i una certa gam m a d i valori, nessu n

nu m ero reale pu ò essere esclu so com e risu ltato possibile

d ell'esperim ento.

In questo caso, lo spazio S contiene un insieme infinito

non numerabile d i punti campione.

Si dice infinito non numerabile uno spazio campione i cui

eventi semplici sono tali per cui, fissati due di essi, è

sempre possibile determinarne almeno un terzo intermedio.

Esempio. Lo spazio costituito dagli eventi “esatto momento

della nascita” è uno spazio infinito non numerabile. Infatti, prese

due qualunque persone nate ognuna in un certo momento, è sempre

possibile individuarne una terza la cui nascita si colloca tra le due

precedenti.

Si possono distinguere tre tipi di spazio campione:

- spazio campione finito

- spazio campione infinito numerabile

- spazio campione infinito non numerabile

Lo spazio cam pione associato ad un esperim ento si d ice

discret o se è uno spazio finito o infinito num erabile.

Lo spazio campione si d ice cont inuo se è uno spazio

infinito non numerabile.

Fenomeno casuale o prova

Lancio di un dado

P

Spazio campionario

(campione)

1

Evento

elementare

Finito

n

Durata di una lampadina

N

i

Infinito

0

max

Quand o un esperimento viene eseguito, uno e un solo

evento semplice può essere osservato. Gli eventi semplici,

d unque, sono mutuamente esclusivi.

Gli eventi mutuamente esclusivi possono essere rappresentati

da insiemi disgiunti.

Esempio. Se il lancio d el d ad o prod uce l'esito 5, non è

possibile osservare allo stesso tem po l'esito 6.

Gli eventi E5 e E6, qu ind i, sono m utuam ente esclusivi, così

com e tutti gli altri eventi sem plici.

Gli eventi com posti non sono d i necessità m utuam ente

esclusivi, in quanto qualsiasi sottoinsiem e d ello spazio

cam pione può costituire un evento com posto.

Esempio. L'evento A (esito dispari) ha lu ogo se si osserva

E1 o E3 o E5.

L’evento B (numero minore di 3) ha lu ogo se si osserva

E1 o E2.

Gli eventi A e B, qu ind i, non sono m u tu am ente esclu sivi.

Eventi incompatibili

B

A

Eventi incompatibili

A B

A

A A

A

Partizione di uno spazio campionario

B

B

A

A

Eventi incompatibili

Partizione di

A B

A

A B , A B

A A

A

A A

Partizione di uno spazio campionario

B

A

Partizione di

A B , A B

E1

a)

Ei

Ek

b)

Ei E j , i j

k

E

i

Partizione finita

i 1

Partizione infinita

Partizione dello Spazio Campionario

Si dice che gli eventi A1,…,Ak appartenenti ad formano una partizione

dello spazio campionario se:

(1)

A i A j i j 1,..., k

k

(2)

A

i

i 1

cioè se sono a due a due incompatibili e necessari.

Unione

Proprietà

Commutativa

Intersezione

A B BA

A B BA

Idempotenza

AA A

Associativa

(A B) C A (B C)

Distributiva

AA A

A (B C) (A B) (A C)

Inoltre, si ha:

A A

A

A

A A

AA

AA

(A B) C A (B C)

A (B C) (A B) (A C)

Leggi di De Morgan

A B A B

k

k

Ei Ei

i 1 i 1

A B A B

k

k

Ei Ei

i 1 i 1

Probabilità

Ogni tentativo di dare una definizione rigorosa dei concetti

probabilistici più elementari si trova di fronte ad un

problema;

infatti,

non

solo

esistono

differenti

formalizzazioni e assiomatizzazioni della probabilità ma a

queste corrispondono, in generale, molteplici nozioni

intuitive di probabilità spesso assai diverse fra loro.

Al di là delle differenze di carattere formale un elemento

comune posseduto da tutte le forme di probabilità riguarda

il suo significato intuitivo di valutazione della possibilità che

un dato evento possa accadere o meno.

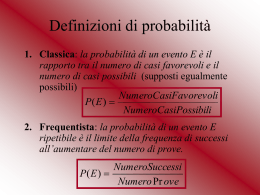

DEFINIZIONE DI PROBABILITA’

•A priori (o matematica, o classica, o di Pascal)

•A posteriori (o statistica, o frequentistica, o legge empirica del

caso)

•Soggettiva

Probabilità:

regola che a ogni evento E associa un

numero reale compreso tra 0 e 1

p: E

p(E)

Definizioni di probabilità:

Classica

(Pascal)

Se un evento si può verificare in N modi mutuamente

esclusivi ed ugualmente probabili, se m di questi

possiede una caratteristica E, la probabilità di E è il

rapporto tra il numero di casi favorevoli e il

totale dei casi possibili (tutti equiprobabili)

Esempi

•Nel caso del lancio di una moneta S={Testa, Croce}.

p(Testa)=1/2 (casi favorevoli 1, possibili 2)

•Lanciamo due dadi e calcoliamo la probabilità che la somma

dei punti sia 4

Per semplicità scriviamo i numeri estratti come coppie:

Le coppie di 6 numeri sono 6 * 6= 36 = numero di casi possibili;

I casi favorevoli sono dati dalle coppie (1,3), (2,2) e (3,1) e sono

quindi 3. Pertanto

p(somma 4 in 2 lanci)=3/36=1/12

Discussione

Problemi della definizione classica:

•non sempre posso dire che eventi sono equiprobabili

(asimmetrie - esempio: ho un dato truccato)

•il numero di casi deve essere finito

Aspetti positivi:

•è una definizione operativa

Definizione

assiomatica

Determinazione

della probabilità

usando il calcolo

combinatorio

Assiomi del Calcolo delle Probabilità.

Ricordando che un assioma (o postulato) è una proposizione che è

considerata vera e non viene dimostrata nel contesto in cui è svolta la

teoria in questione, Il C.P. presenta i seguenti assiomi:

1.

Pr A 0 A A

2.

Pr 1

Probabilità

L’interpretazione geometrica

P () 1

L’area complessiva è uguale a 1

1

P( ) 0,

A

L’area di ogni sottoinsieme è

sicuramente positiva

3

P n P n

n 1 n 1

L’area di un insieme di superfici che non si

sovrappongono è la somma delle aree delle singole

superfici

4

2

Operazioni sugli eventi (sugli insiemi)

Se un insieme E non

contiene nessun elemento

(evento elementare) viene

detto insieme vuoto e si

indica con

Unione di insiemi (o eventi)

B

A

A

A B : A oppure B

A

A

A A A

A

A A

Lancio di un dado

A E

E=

A=

,

,

,

,

,

,

Unione

A B C

B

Associativa

A

Commutativa

C

A B C

A B C

A C B

K

E

i

Ecc.

E1 E2 Ei Ek

i 1

E

B

i

A

E1 E2 Ei

i 1

C

K

Ei

i 1

K

K

Ei Ei

i 1

i 1

Intersezione

B

A

A

A B : A e B

A A A

A

A

A A

A

Lancio di un dado

E=

A=

,

,

A E

,

Intersezione

A B C

B

Associativa

A

C

A B C

A B C

Commutativa

A C B

k

E

i

Ecc.

E1 E2 Ei Ek

i 1

E

B

i

A

E1 E2 Ei

i 1

C

k

k

Ei Ei

i 1

i 1

k

Ei

i 1

Negazione

A

A

A

A

A : A

A A

Teoremi fondamentali del C.P.

Siano A e B due eventi incompatibili

allora

A B

Pr A B Pr A Pr B

Teo.1.

Pr 0

Teo.2.

Pr A 1 Pr A

Teo.3.

Pr A Pr A B Pr A B

Teo.4.

Pr A B Pr A Pr B Pr A B

Definizione frequentistica

(o a posteriori)

Richard von Mises

Si ripete un esperimento N volte e se un evento con una

certa caratteristica E si verifica m volte, la frequenza

relativa di successo è

f(E) dà una stima per la probabilità di E

In base all’impostazione frequentista, per probabilità di un

evento si intende il limite a cui tende la frequenza relativa

delle prove in cui l’evento si verifica, quando il numero di

prove tende all’infinito:

s

lim p

n n

con s = numero di “successi” e n = numero di prove.

Problemi della definizione frequentistica:

•In situazioni concrete il passaggio al limite su cui si basa la

definizione non può essere effettuato

•È necessario ripetere l’esperimento un gran numero di volte

Definizione soggettiva

(o bayesiana)

Bernoulli, De Finetti

Probabilità: grado di fiducia che una persona ha nel

verificarsi dell’evento.

Prezzo p che si è disposti a pagare per ricevere 1 se

l’evento si verifica e 0 se non si verifica.

Esempio: se lancio un dado il prezzo equo per la scommessa

“esce il 4” dipende dalle informazioni di cui si dispone; se il dado non

è truccato si può assumere p=1/6

Problemi della definizione soggettiva:

•Non è operativa

•Una valutazione soggettiva non è necessariamente obiettiva

Definizione di probabilità.

Def. 4. Classica

La probabilità di un evento A è il rapporto tra il numero di casi favorevoli

di A e il numero di casi possibili, ammesso che questi siano equiprobabili.

Def. 5.. Frequentista (o legge empirica del caso).

In una serie di prove di un dato esperimento, ripetuto un gran numero di

volte in circostanze più o meno simili, ciascuno degli eventi possibili si

manifesta con una frequenza che è circa uguale alla sua probabilità.

L’approssimazione si riduce al crescere del numero di prove.

Def. 6. Soggettivista.

La probabilità è la valutazione che il singolo individuo può coerentemente

formulare, in base alle proprie conoscenze, del grado di avverabilità di un

evento.

ESERCIZI

A volte puo essere difficile, o almeno noioso, determinare per

elencazione diretta gli elementi di uno spazio campione

finito.

CALCOLO COMBINATORIO

Disposizioni semplici

Disposizioni con Ripetizione

Permutazioni semplici

Permutazioni con oggetti identici

Combinazioni Semplici

Combinazioni con Ripetizione

Calcolo Combinatorio

Problema: determinare il numero di

elementi di un insieme finito

elenco diretto (lungo!)

Esempio:in un menù ho 3 antipasti, 2 primi, 4 secondi.

Quanti sono i possibili pasti completi (includono tutte le 3

portate - scelte una sola volta)?

Diagramma ad albero

Diagramma ad albero

S1

S2

P1

S3

A1

S4

P2

A2

P1

P2

P1

A3

3

……….

……….

………..

P2

x

2

x

4 = 24

pasti completi

“Contare le scelte”

Se gli insiemi A1, A2, …, Ak contengono

n1, n2, …, nk elementi

Ho

N= n1 n2 … nk

modi di scegliere

prima un elemento di A1 , poi un elemento di A2 …

...

infine un elemento di Ak

In particolare: se n1 = n2 =…= nk =n allora

N=nk

= numero delle disposizioni con ripetizione

di n oggetti a gruppi di k

Disposizioni

= gruppi di oggetti che si possono formare

scegliendo k oggetti tra n oggetti

(I gruppi devono differire per qualche oggetto e per

l’ordine)

Disposizioni con ripetizione: si può ripetere lo stesso oggetto

Esempio:

Determinare il numero di schedine del totocalcio si

devono giocare per essere sicuri di fare 14

Le possibili schedine sono 314= 4.782.969

Disposizioni semplici (senza ripetizione)

di n oggetti tra k (≤n)

D(n,k)

Non si può ripetere lo stesso oggetto

Esempio:

Ad un gran premio di formula 1 partecipano 20 piloti.

I primi tre classificati vanno sul podio..

Quante sono le possibili terne di piloti sul podio?

Il primo classificato può essere un qualunque pilota tra 20,

Il secondo uno qualunque tra i restanti 19, il terzo uno tra 18

Quindi: D(20,3)=20*19*18

In generale: D(n,k)=n*(n-1)*…*(n-k+1)

Permutazioni

= numero dei modi in cui si possono ordinare n oggetti

P(n) = D(n,n)=n*(n-1)*… 2*1=n!

Esempio:

Quanti anagrammi (non necessariamente di senso

compiuto) si possono formare della parola FOGLI

Ho 5 possibili scelte per la prima lettera, 4 per la seconda, …

1 per la quinta, quindi gli anagrammi sono

P(5)=5*4*3*2*1=5!=120

Combinazioni

= disposizioni a meno dell’ordine=

gruppi di oggetti che si possono formare scegliendo k

oggetti tra n oggetti

(I gruppi devono differire per qualche oggetto ma non per l’ordine)=

Esempio

Quante squadre di pallacanestro si possono formare con 8

giocatori

Sono le combinazioni di 5 persone scelte tra 8 =

Esercizi

• In quanti modi 10 persone possono sedersi su una panchina che ha solo 4

posti? (Si risolva l'esercizio due volte, una volta considerando importante l'ordine in

cui si siedono e una no).

• In quanti modi diversi si possono sedere 7 persone in un tavolo rotondo?

• Supponiamo di estrarre per 40 volte una pallina da un'urna contenente

palline numerate da 1 a 365 ( dopo ciascuna estrazione la pallina estratta

viene nuovamente messa nell'urna). Quanti sono i possibili risultati

diversi? Quanti sono i possibili risultati in cui i 40 numeri estratti risultano

tutti diversi tra loro?

• Si deve costituire un comitato di 3 membri, rappresentanti ciascuno gli

studenti, i docenti e il personale amministrativo. Se ci sono 4 candidati per

gli studenti, 3 per i docenti e 2 per il personale amministrativo, si determini

quanti comitati differenti si possono formare.

Esercizi

• Dovete preparare un dolce, disponete di una cesta con 10 uova di cui ve ne

serviranno solo 2 per l'impasto. Ma vi ricordate che il giorno prima avete

posto in quel cesto 4 uova vecchie di due settimane. Qual è la probabilità di

aver utilizzato almeno un uovo non fresco?

• Intorno ad un tavolo rotondo si dispongono a caso 5 uomini e 5 donne.

Qual è la probabilità che ogni donna sia seduta tra due uomini?

• Qual è la probabilità di fare tre volte 6 lanciando tre volte un dado non

truccato?

Probabilità condizionata e

indipendenza stocastica

Esempio: un’urna contiene 15 palline rosse e 5 nere.

Calcoliamo la probabilità di ottenere in 2 estrazioni consecutive senza

reimbussolamento una pallina rossa e poi una nera:

A:=estraggo una rossa

B:=estraggo una nera

p(A)=15/20=3/4

La probabilità di estrarre una nera dopo aver estratto una rossa è 5/19.

La conoscenza dell’evento A ha ridotto lo spazio dei campioni

Dati due eventi A e B, si dice probabilità di B condizionata ad A

p(B|A) la probabilità di B calcolata sapendo che si è verificato A.

(E’ ovvio che si può definire una probabilità condizionata al verificarsi di A

soltanto se A è possibile.)

p(B|A)

= 5/19

La probabilità di estrarre prima una rossa e poi una

nera è

p(AB)=p(A)p(B|A)=3/4*5/19=15/76

Regola di moltiplicazione:

p(B|A) in funzione di p(A) e p(AB)

se p(A)≠0

Esempio: trovare la probabilità che con un lancio di un dado si

ottenga un numero < 5, sapendo che il risultato del lancio è dispari

B:={ottengo un numero < 5}

A:={ottengo un dispari}

p(B)=2/3,

p(A)=1/2,

A B={1,3}, p(A B)=1/3

p(B|A)=p(A B)/p(A)=(1/3)/(1/2)=2/3

Esercizio

La seguente tabella rappresenta la frequenza mensile in cui dei

ragazzi vedono il telefilm “Friends”

Numero di volte al mese

Maschi

Femmine

Totale

0

4

5

9

1-5

7

9

16

6 - 10

21

23

44

11 - 15

11

9

20

>15

3

5

8

Totale

46

51

97

Scelgo una persona a caso.

•Qual è la probabilità che non veda mai il telefilm?

p(0)=9/97

•Se è un maschio, qual è la probabilità che non veda mai il telefilm?

p(0|M)=4/46

Indipendenza stocastica

Se per due eventi A e B p(A|B)=p(A)

si dice: l’evento A è stocasticamente indipendente da B

Esempi:

•Nell’esercizio precedente: non vedere mai il telefilm “Friends” ed essere

maschio non sono stocasticamente indipendenti

•Siano

A:={una persona è alta più di 1 metro e 75}

B:={una persona non mangia Nutella}

Supponiamo che p(A)=0.5, p(B)=0.3, p(AB)=0.15

Allora p(A|B)=p(AB)/p(B)=0.15/0.3=0.5=p(A)

Dunque A è stocasticamente indipendente da B.

Indipendenza stocastica

Nota: p(B|A)=p(AB)/p(A)=0.15/0.5=0.3=p(B)

anche B è stocasticamente indipendente da A.

Questo non è casuale:

A è stoc. indipendente da B

B è stoc. indipendente da A

e diciamo “A e B sono indipendenti”

Esempio:

in un’urna ci sono 10 palline rosse e 12 nere. Estraiamo dall’urna una

pallina poi la rimettiamo nell’urna (estrazione con reimbussolamento).

Siano

A1={estraggo una pallina rossa alla prima estrazione}

A2={estraggo una pallina rossa alla seconda estrazione}

L’aver estratto una rossa alla prima estrazione non influenza la

probabilità che la seconda sia rossa

A1 e A2 sono indipendenti

Regola di moltiplicazione per eventi

indipendenti

Esempio: Nel caso dell’estrazione con reimbussolamento

dell’esempio precedente la probabilità di estrarre entrambe le

volte una pallina rossa è

p(A1A2)=p(A1)p(A2)=(10/22)2

Vale la seguente regola di moltiplicazione per eventi

indipendenti A e B:

p(AB)=p(A)p(B)

Nota: non confondere i concetti di “eventi disgiunti” ed “eventi

indipendenti”. Due eventi disgiunti non sono mai indipendenti (se cosi

fosse avrei p(AB)=p(ø)=0=p(A)p(B), quindi p(A) o p(B) sarebbe nulla).

In realtà due eventi disgiunti sono fortemente dipendenti: se un evento è

realizzato non può esserlo l’altro.

Esercizio

Si hanno tre urne.

U1 ha 2 palline bianche e 2 nere

U2 ha 1 pallina bianca e 3 nere

U3 ha 4 palline bianche e 2 nere

Si sceglie un’urna a caso e si estrae una pallina.

Qual è la probabilità di estrarre una pallina bianca?

U1

1/3

1/3

U2

1/3

U3

1/2

1/4

2/3

bianca

bianca

bianca

P(bianca)=1/2 * 1/3 + 1/4 * 1/3 + 2/3 * 1/3=17/36

Se B è un evento che si verifica insieme ad n eventi incompatibili A1,…,An

A1 ,..., An , , B ,

PB PB A1 .... PB An

P( B | A1 ) P( A1 ) ... P( B | An ) P( An )

effetto

cause

L’utilità del teorema sta nel fatto che talvolta P(A) è

difficile da calcolare direttamente, mentre è più facile

calcolare le probabilità P(A/Bi) e poi ricostruire P(A)

dalla formula

Dr. Daniela Morale

Teorema delle probabilità totali

Esercizio

In un Gran Premio di Formula 1 la probabilità di

pioggia è del 30%.

La probabilità che il pilota Mazzacane vinca se piove è

dello 40%, e dello 10% se non piove.

• Qual è la probabilità che vinca Mazzacane?

Sia P={piove} M={vince Mazzacane}

0.3

P

0.4

M

0.7

Pc

0.1

M

p(M)=0.3*0.4+0.7*0.1=0.19

Teorema di Bayes

Se B è un evento che si verifica insieme ad n eventi incompatibili A1,…,An se

sappiamo che B si è verificato, ci si può porre il problema di calcolare la

probabilità che B venga da uno di tali eventi, un generico Ai

effetto

causa

Esercizio (continuazione)

In un Gran Premio di Formula 1 la probabilità di

pioggia è del 30%. La probabilità che il pilota

Mazzacane vinca se piove è dello 40% e dello 10%, se

non piove.

• Se vince Mazzacane qual è la probabilità che piova?

Sia P={piove} M={vince Mazzacane}

0.3

P

0.4

M

0.7

Pc

0.1

M

p( M | P) p( P)

p( P | M )

p( M | P) p( P) p( M | P) p( P)

0.4 0.3

0.63

0.4 0.3 0.1 0.7

Esercizio

Sia C l’evento: la nuova sede di scienze sarà pronta nel 2019

e sia E : l’impresa a cui è dato l’appalto fallirà prima del 2018.

Se la probabilità che la ditta fallisca prima del 2018 è del 60% e

la probabilità che la sede sia pronta è dello 0.15 o dello 0.75 a seconda

se la ditta fallisce o no prima del 2018, calcolare la probabilità che

se la sede è pronta in tempo, la ditta sia non fallita prima del 2018

p(C|E)=0.15

p(E)=0.60

p(Ec)=0.40

C

E

Ec

p(C| Ec)=0.75

C

Da trovare p(Ec | C)

Nella formula del teorema di Bayes

A numeratore: moltiplicare i numeri del ramo

relativo a S-E (quello in basso):

p(Ec) * p(C | Ec)=0.40 * 0.75 = 0.30

A denominatore: somma dei prodotti delle

probabilità di entrambi i rami

p(E)*p(C | E)+p(Ec) * p(C | Ec)=

=0.60 * 0.15 + 0.40 * 0.75 = 0.39

Si trova allora p(Ec | C)=0.30/0.39=0.77

Esercizio di riepilogo

La seguente tabella mostra 1000 candidati di una scuola per infermieri

classificati secondo il punteggio riportato all’esame di ingresso

all’università e la qualità della scuola superiore da cui provenivano

Punteggi o

Bass o

Medio

Alto

Tota le

Sca rsa

Discreta

105

70

25

200

Ottim a

60

175

65

300

Tota le

55

145

300

500

220

390

390

100 0

Dire qual è la probabilità che un candidato

1. Abbia avuto un punteggio basso all’esame.

2. Si sia diplomato in una scuola ottima

3. Abbia avuto un punteggio basso e si sia diplomato in una scuola

ottima.

4. Ammesso che si sia diplomato in una scuola ottima, abbia avuto un

punteggio basso

Una v ariabile aleat oria è u na fu nzione avente com e

d om inio lo spazio cam pione associato ad u n

esperim ento e com e cod om inio l’insiem e d ei nu m eri

reali.

X :

Una variabile aleatoria si d ice discret a se pu ò

assu m ere solo u n nu m ero d iscreto d i valori;

si d ice cont inua se pu ò assu m ere tu tti gli

infiniti valori d i , o d i u n su o intervallo a, b .

Dunque, una v.c. è una regola (una funzione) che permette di assegnare

un valore numerico ad ogni risultato dell’esperimento.

Dalla definizione è evidente che dato uno spazio campionario è

possibile costruire infinite v.c. (si osserva che tale funzione non deve

essere necessariamente biunivoca).

COME SI ASSOCIANO LE PROBABILITA’ ALLE

VARIABILI ALEATORIE?

La probabilità che la variabile Y assu m a il valore y,

P Y y , è d efinita com e la som m a d elle probabilità d i

tu tti i pu nti cam pione in S a cui viene assegnato il

valore y.

Generalm ente, si d enota P Y y con p(y).

Si noti che p(y) non è altro che u na funzione che assegna

u na probabilità a ciascu n valore y ed è chiam ata funzione

(o d istribu zione) di probabilità d i Y .

La funzione d i probabilità d i u na variabile aleatoria

d iscreta Y pu ò essere rappresentata con u na form u la, u na

tabella o u n d iagram m a che associa la probabilità p(y) a

ciascu n valore y.

Una funzione d i probabilità p y d eve rispettare le

segu enti cond izioni:

0 p y 1

p y 1.0

y

Esempio Un esperim ento consiste nel lancio d i d ue

d ad i. Sia Y la somma dei punti osservati quando i due dadi

sono stati tratti.

Si trovi la d istribuzione d i probabilità d i Y .

Lo sp azio cam p ione associato a qu esto esp erim ento è

S i, j : 1 i, j 6 , ovvero, l'insiem e d i tu tte le cop p ie

ord inate (i, j) d i nu m eri interi 1 i 6 e 1 j 6 che

rap p resentano l’esito d el lancio d i ciascu no d ei d u e d ad i.

In S ci sono 36 eventi sem p lici:

E1 1,1 , E 2 1,2 , E 3 1,3 , E 4 1,4 , E 5 1,5 , E 6 1,6 ,

E 7 2,1 , E8 2,2 , E9 2,3 , E 10 2,4 , E 11 2,5 , E12 2,6 ,

E 13 3,1 , E14 3,2 , E 15 3,3 , E 16 3,4 , E 17 3,5 , E 18 3,6 ,

E 19 4,1 , E 20 4,2 , E 21 4,3 , E 22 4,4 , E 23 4,5 , E 24 4,6 ,

E 25 5,1 , E 26 5,2 , E 27 5,3 , E 28 5, 4 , E 29 5,5 ,E 30 5,6 ,

E 31 6,1 , E 32 6,2 , E 33 6,3 , E 34 6,4 , E 35 6,5 ,E 36 6,6 .

Y 2 E1 ,

Y 3 E 2 , E7 ,

Y 4 E3 , E8 , E13 ,

Y 5 E4 , E9 , E14 , E19 ,

Y 6 E5 , E10 , E15 , E 20 , E 25 ,

Y 7 E6 , E11 , E16 , E21 , E26 , E31 ,

Y 8 E12 , E17 , E 22 , E 27 , E32 ,

Y 9 E18 , E13 , E28 , E33 ,

Y 10 E24 , E29 , E34 ,

Y 11 E30 , E35 ,

Y 12 E36 .

Una volta trovate le probabilità d egli eventi sem plici in S,

la probabilità d a assegnare a ciascu n valore y si calcola

facend o la som m a d elle probabilità d i tu tti i pu nti

cam pione in S a cu i è associato il valore y.

P Y 2 P E1 1 36

PY 3 PE1 PE7 2 36

PY 4 PE1 PE7 PE13 3 36

In questo modo la distribuzione di probabilità di Y diventa:

Y

2

3

4

5

6

7

8

9

10

11

12

p(y) 1/ 36 2/ 36 3/ 36 4/ 36 5/ 36 6/ 36 5/ 36 4/ 36 3/ 36 2/ 36 1/ 36

La d istribuzione d i probabilità d i una variabile aleatoria

d iscreta Y può essere rappresentata in maniera grafica

costruend o un istogram m a che associa a ciascun valore

Y = y un rettangolo avente am piezza 1/n (d ove n è il

num ero d i valori che la variabile aleatoria può

assum ere) e altezza p(y).

In qu esto mod o, l’area d i ciascun rettangolo sarà ugu ale

alla probabilità P(Y = y) e l’area totale d i tu tti i rettangoli

che form ano l’istogram m a sarà ugu ale a 1.

N e segu e che la probabilità Pc Y d , con a c d b ,

sarà ugu ale alla som m a d elle aree d ei rettangoli

d ell'istogram m a nell'intervallo

[c, d ] .

Esempio Se l’esperim ento d escritto nell’esem pio

preced ente fosse effettivam ente esegu ito, u n singolo

valore Y verrebbe osservato.

Il valore d i Y potrebbe essere 2, 3, 4, 5, 6, 7, 8, 9, 10, 11 o 12.

Se l’esperim ento venisse ripetu to n volte, n valori y

verrebbero osservati.

Su pponiam o che, d opo avere esegu ito l’esperim ento 100

volte, i segu enti risu ltati vengano osservati.

Y

Frequ enze

Frequ enze

osservate in

relative

100 lanci

y1 = 2

3

.03

y2 = 3

4

.04

y3 = 4

7

.07

y4 = 5

11

.11

y5 = 6

17

.17

y6 = 7

21

.21

y7 = 8

13

.13

y8 = 9

12

.12

y 9 = 10

8

.08

y 10 = 11

3

.03

y 11 = 12

1

.01

Si noti la som iglianza tra i d ue istogram m i.

In seguito verrà presentato un teorem a in cui si

d im ostra che, all’aum entare d el num ero d elle

ripetizioni d i un esperim ento, la d istribuzione d elle

frequenze em piriche si approssim a sem pre più alla

d istribuzione teorica d i probabilità.

Costruiamo una v.c. e le corrispondenti probabilità in due fasi:

1. Ad ogni evento di si associa uno ed un solo numero reale X(e).

Questa operazione definisce una v.c. X.

2. Ad ogni possibile valore di X(.) si associa una probabilità Pr[X].

Questa operazione definisce la distribuzione di probabilità della v.c. X.

Si osserva che mentre la regola da adottare è arbitraria in quanto

dipende da ciò che vogliamo che la v.c. interpreti, lo stesso non è vero

per la determinazione della distribuzione di probabilità Pr[X] in quanto

quest’ultima è legata alle probabilità degli eventi elementari Pr[e].

Anziché specificare le singole P[X] si cercherà, ove possibile, di determinare

la relazione funzionale che lega queste probabilità, sintetizzata in una

funzione f(x). Ciò sarà necessario quando la v.c. X è di tipo continuo o

discreto con un numero molto elevato di valori.

In alcuni casi, sarà necessario calcolare la probabilità che X assuma un

valore minore o uguale a xk, cioè

Pr X xk F ( xk )

Questa funzione è detta funzione di ripartizione (f.r.) ed è uguale a:

F ( xk ) f ( x1 ) f ( x2 ) ... f ( xk )

f (x )

xi xk

i

Proprietà della f.r. F(.):

1.

F () 0

2.

F ( xn ) F () 1

3.

F ( xi ) F ( xi 1 ) f ( xi )

La rappresentazione di F(x) è una “funzione a gradini”.

Valore atteso e varianza

Per le variabili discrete è possibile definire un valore atteso E[x]

ed una varianza Var[x] che sono analoghe alle misure di

posizione e dispersione del valore medio e dello scarto

quadratico medio:

imax

E[ x] xi pi

i 1

imax

2 Var[ x] ( xi ) 2 pi

i 1

Valore atteso e varianza

non coincidono con media e scarto

quadratico medio

imax

E[ x] xi pi

i 1

imax

x xi f i

i 1

imax

2 Var[ x] ( xi ) 2 pi

i 1

imax

S 2 ( xi x ) 2 f i

i 1

Per un numero di tentativi molto elevato è ragionevole

che si identifichino le fi e le pi.

In preced enza abbiam o osservato che la d istribu zione d i

probabilità d i u na variabile aleatoria d iscreta Y pu ò

essere generata assegnand o u na probabilità p(y)

m aggiore o u gu ale a zero a ciascu no d ei valori che Y pu ò

assu m ere, in m od o tale che

p y 1 .

y

La d istribu zione d i probabilità d i u na variabile aleatoria

continu a, p erò, non pu ò essere specificata nello stesso

m od o.

N on è possibile, infatti, assegnare u n valore non nu llo a

ciascu no d egli infiniti valori che u na variabile aleatoria

continu a pu ò assu m ere e, allo stesso tem po, rispettare il

vincolo second o cu i la som m a d i tali p robabilità d eve

essere u gu ale ad 1.

Per assegnare i valori d i probabilità ad u na variabile

aleatoria continu a d obbiam o d u nqu e proced ere in u n

altro m od o.

Distribuzioni di probabilità continue

y

y

x

a

b

x

Sono descritte da funzioni.

L’area sottesa dalla curva tra due valori (es. a-b) è la probabilità

che la variabile casuale assuma valori compresi tra a e b

Si presuppone l’esistenza di una funzione f(x) t.c.

Si definisce poi la probabilità che X sia compresa

fra a e b nel modo seguente:

Questa definizione soddisfa gli assiomi della teoria

della probabilità.

La funzione f(x) è detta densità di probabilità

f y 0

f y dy 1

f(y), non è la probabilità, ma è proporzionale (a meno di un

infinitesimo) alla probabilità di un intervallo <<sufficientemente

piccolo>>

La probabilità che X prenda un valore nell’intervallo [a,b] è l’ area

sotto la pdf fra a e b.

La funzione di distribuzione (o ripartizione) F(x), di una variabile

aleatoria X, ed è definita per x da

P( x A x x B )

xB

f ( x)dx

xA

f(x)

L’integrale è la

probabilità che la

variabile casuale

assuma un valore

in un intervallo e

dipende dalla

densità di

probabilità f(x)

XA

XB

x

Probabilità d iverse d a zero possono qu ind i essere assegnate

ad intervalli di valori d i u na variabile aleatoria continu a X .

A ciascu no d ei singoli valori che la variabile aleatoria

continu a pu ò assu m ere, invece, è sem pre associata u na

probabilità u gu ale a zero, P(X = x) = 0.

Qu est’u ltim a afferm azione risu lta p iù facilm ente

com p rensibile se interp retiam o la p robabilità in term ini

geom etrici:

l’area sottesa alla fu nzione d i d ensità f(x) nell’intervallo

corrisp ond ente ad u n p u nto è necessariam ente u gu ale a

zero.

Cosa significa in pratica il fatto che una probabilità

uguale a 0 viene associata ad un evento perfettam ente

legittim o e possibile (ovvero, l'evento corrispond ente al

fatto che la variabile aleatoria continua assum a un

d eterm inato valore)?

Esempio. Sia X la variabile aleatoria continu a

corrispond ente all'altezza in centim etri d i uno stu d ente

scelto a caso d alla popolazione stu d entesca universitaria.

Su pponiam o d i d isporre d i uno stru m ento infinitamente

preciso per misu rare l'altezza e poniam o che l'altezza

d egli stu d enti universitari vari tra 150 e 210 cm .

La variabile aleatoria X , qu ind i, potrà assu m ere qu alsiasi

valore com preso in qu esto intervallo.

Consid eriam o ora un particolare evento all'interno d ello

spazio cam pione, ovvero l'evento X = 173.128735274 cm .

Pu r essend o qu esto un valore che X pu ò legittim am ente

assu m ere, non sarà facile trovare uno stu d ente che abbia

esattamente qu esta altezza.

Potrem m o continu are a m isu rare l'altezza d i m oltissim i

stu d enti senza m ai osservare l'evento in qu estione. Qu esto

ci porterebbe a conclu d ere tale evento è talm ente

im probabile che ad esso pu ò essere assegnata una

probabilità ugu ale a 0.

La funzione f(x) non è una probabilità, è solo il suo

integrale su un intervallo (che ha il significato di

probabilità).

Nel caso discreto invece, la distribuzione di probabilità

f(xk) è per definizione la probabilità P(X=xk)

Distribuzioni discrete e densità continue sono oggetti

matematici di tipo diverso, non confrontabili fra loro.

Lo strumento che consente di confrontare variabili

aleatorie continue e discrete sono invece le rispettive

funzioni di distribuzione.

Variabili continue: limite

del caso discreto

f(x)

Valore atteso per variabili continue

Variabili

continue

E[ x]

xf ( x)dx

xMin

Somma

Variabili

discrete

xmax

prob

di avere

x

imax

E[ x] xi pi

i 1

Varianza per variabili continue

Variabili

continue

2 Var[ x]

xmax

2

(

x

)

f ( x)dx

xMin

Somma

Variabili

discrete

Scarto

quadratico

imax

probabili

tà

di x

2 Var[ x] ( xi ) 2 pi

i 1

Def. 11. Momenti semplici di ordine r.

Se X è una v.c. il momento di ordine r, con r naturale, è definito

dalla seguente:

x

E Xr

r

f ( x)dx

Nel caso continuo.

E X r x rj f ( x j )

Nel caso discreto

j

Si osserva che per r=1 si ottiene il valore atteso (aspettativa) di X.

Def. 12. Momenti centrali di ordine r.

Se X è una v.c. il momento centrale di ordine r, con r naturale, è

definito dalla seguente:

x E ( X ) f ( x)dx

E X E ( X )

r

r

Nel caso continuo

E X E ( X ) x j E ( X ) f ( x j )

r

r

j

Si osserva che per r=2 si ottiene la varianza di X.

Nel caso discreto

Il teorema di Bayes nel caso di variabili aleatorie

continue assumen la seguente formulazione

p ( B | A)

p( A | B) p( B)

p( A | B) f (b)db

Dove f è la fuzione di densità di probabilità della

variabile aleatoria B

Scaricare