TQuArs – a.a. 2010/11 Tecniche quantitative per l’analisi nella ricerca sociale Giuseppe A. Micheli Lezione B.8 Regressione lineare In questa lezione.. In questa lezione ripartiremo dall’interpolazione di una nuvola di punti mediante la spezzata di regressione (funzione che è la migliore di tutte le possibili interpolanti), per poi passare a funzioni rettilinee, magari meno buone, ma capaci di spiegare e di estrapolare. Faremo la conoscenza con le stime dei parametri di una retta ottenute col metodo dei minimi quadrati. In particolare: Esamineremo le proprietà di queste stime. Svilupperemo le procedure di calcolo e di estrapolazione. Individueremo una idonea misura di goodness of fit. Accenneremo alla stima della retta con intercetta vincolata. Confronteremo le stime ottenute con quelle che si ottengono interpolando la retta entro la linea di regressione. Preciseremo la procedura di calcolo per dati in forma di tabella. La linea di regressione ha davvero scarso appeal La funzione (di qualunque tipo) che si adatta ‘meglio’ ai dati di una nuvola di punti, minimizzando la funzione di perdita, è solo e sempre la spezzata di regressione. Ma francamente, la spezzata è una legge che non soddisfa le nostre esigenze interpretative e decisionali. Per almeno due ordini di motivi: Perché, essendo una funzione ‘ad assetto variabile’, priva di una sua personalità, non ci consente di cogliere il tipo di relazione tra X e Y (Y cresce con progressione aritmetica o geometrica con X? E’ monotona crescente o ha un picco e poi cala con una forma parabolica, o oscilla in forma sinusoidale?). Non ci consente insomma di individuare una ‘legge semplice e chiara che definisca Y in funzione di X’. Perché non ci consente di fare simulazioni sul variare di Y per valori non osservati di X (per esempio, data la spezzata di regressione, quale potrebbe essere una performance attesa a 23 o a 24 anni?): non ci consente cioè di estrapolare stime fuori del campo di variazione osservato. Ben consapevoli di non trovare la migliore interpolante possibile, preferiamo allora cercare non una generica funzione, ma la retta Yj = i = a + bxi che meglio si adatta ai punti del grafico. Stimare la retta miglior interpolante Si tratta insomma di stimare i parametri a (intercetta all’origine) e b (pendenza) della retta che minimizzano la funzione di danno quadratico: D = (yj - i)2fij = (yj – a - bxi)2fij = min Ma quale retta, tra le infinite possibili che passano entro la nuvola di punti, è quella che meglio vi si adatta, minimizzando D? Proviamo a interpolare tra i dati due possibili regole. La seconda Y**=E(Y) ha una varianza residua elevata VW**=23,4. La prima Y*=180+2X, tracciata ‘a naso’ si adatta assai meglio. Ma sarà la migliore? Xi Yi Y*i= 180+2X i (Yi-Y*i)2 Y**i= 220 (Yi-Y**i)2 18 212 216 16 220 64 230 18 218 216 4 220 4 226 18 215 216 1 220 25 19 218 218 0 220 4 19 220 218 4 220 0 20 218 220 4 220 4 20 224 220 16 220 16 21 220 222 4 220 0 21 226 222 16 220 36 22 229 224 25 220 81 19,6 220 222 218 214 210 17 18 19 20 21 22 23 9,0 23,4 Stimare col metodo dei minimi quadrati Si definisce “Metodo dei Minimi Quadrati” (MMQ) quello che consente di stimare la forma analitica dei parametri che minimizzino la funzione D. Si dimostra che le stime ai Minimi Quadrati (LS, least squares) della retta sono: aYX = intercetta all’origine = mY – bYXmX bYX = coefficiente angolare = covYX/varX La retta stimata ai MQ ha la forma analitica: Y a yx byx X my cov yx var x mx cov yx var x X my cov yx var x X mx Quel che c’è di intrigante nel Metodo dei Minimi Quadrati è che per stimare la retta ottima interpolante è sufficiente avere a disposizione quattro soli parametri statistici empiricamente calcolabili. Di questi uno solo (la covarianza) ha a che fare con la distribuzione congiunta (Y,X). Gliu altri tre (le due medie e la varianza della variabile indipendente, o esplicativa) sono addirittura parametri univariati! La procedura di calcolo Per stimare la retta ai MQ dobbiamo dunque impiantare la tavola di calcolo già usata per rXY (i quadrati di Y non servono, ma tra poco torneranno utili!!). I calcoli intermedi sono: mX=19,6; mY=220; m2X=386; VX=1,84; mXY=4317,6; covXY=+5,6. Quindi bYX=covYX/varX=5,6/1,84=3,04 e aYX=mY–bYXmX=220-(3,04x19,6)=160,35 Nella fattispecie, la retta ai MQ – con pendenza più forte di quella precedente - ha una varianza residua ancora migliore (6,357 vs 9). Si noti un’altra proprietà delle stime Y*i basate sulle stime MQ: esse lasciano inalterata l’intensità totale di Y. Inoltre VY=23,4 e rXY=0,853. Xi Yi Y i2 X i2 X iY i Y*i=a+bXi (Yi-Y*i)2 230 226 222 218 214 210 17 18 19 20 21 22 23 18 212 44944 324 3816 215,13 9,80 18 218 47524 324 3924 215,13 8,23 18 215 46225 324 3870 215,13 0,02 19 218 47524 361 4142 218,17 0,03 19 220 48400 361 4180 218,17 3,33 20 218 47524 400 4360 221,22 10,36 20 224 50176 400 4480 221,22 7,74 21 220 48400 441 4620 224,26 18,16 21 226 51076 441 4746 224,26 3,02 22 229 52441 484 5038 227,30 2,88 19,6 220 48423 386 4317,6 220,00 6,357 Interpolare, estrapolare La retta ai MQ stimata è Y* = 160,35 + 3,04X. La prima cosa da fare è tracciarla entro il grafico, per ‘vedere’ l’andamento della ‘legge rettilinea’ che associa X a Y. Per tracciarla basta calcolare i valori teorici Y* corrispondenti a due valori di X agli estremi del grafico (per es.: se X=18 Y*=215,13) e poi congiungerli. Ma possiamo ora anche ‘estrapolare’ stime dalla funzione. Per esempio, nessun atleta seguito ha 23 anni, ma in base alla nostra funzione possiamo prevedere che a 23 anni la performance possa essere Y*=160,35+(3,04x23)=230,27 (wow!). 230 226 222 218 214 210 17 18 19 20 21 22 23 se la retta non si insinua bene tra i da-ti delle due l’una: o avete sbagliato a calcolare la retta o avete sbagliato a tracciarla!! Xi Yi Y*i=a+bXi (Yi-Y*i)2 18 212 215,13 9,80 18 218 215,13 8,23 18 215 215,13 0,02 19 218 218,17 0,03 19 220 218,17 3,33 20 218 221,22 10,36 20 224 221,22 7,74 21 220 224,26 18,16 21 226 224,26 3,02 22 229 227,30 2,88 19,6 220 220,00 6,357 Scomporre la varianza intorno alla retta ai minimi quadrati Abbiamo detto che la proprietà di spaccare (scomporre) la varianza totale della variabile da spiegare in due parti (una quota ‘spiegata’ dall’explanans e una ‘residuale’) vale per poche funzioni y=(x), oltre alla spezzata di regressione. La proprietà di scomposizione della varianza vale per le funzioni lineari di regressione stimate col metodo dei MQ, e in primo luogo per la retta MQ: VarT(Y) = VarWR + VarBR dove VarWR è la somma dei quadrati degli scarti tra valori osservati e ‘teorici’ (calcolati cioè in base all’equazione stimata) ponderati per le rispettive frequenze. Analogamente al rapporto di correlazione 2YX possiamo così costruire una misura del grado di adattamento (goodness of fit) della retta MQ ai dati, ossia una misura del grado in cui la relazione rettilinea con l’explanans X ‘spiega’ la variabilità di Y. La misura è: 230 226 222 218 214 210 17 18 19 20 21 22 23 varBR (Y ) varW R (Y ) R 1 varT (Y ) varT (Y ) 2 yx Il coefficiente di determinazione Come YX anche 2YX è una quantità compresa tra 0 e 1, che si può calcolare come complemento a uno del rapporto tra la varianza residua e la varianza totale di Y. Nel caso dei 10 atleti V(Y)=23,4; VWR(Y)=6,353; R2YX=1-(6,353/23,4)=0,728. Possiamo dire che il 72,8% della variabilità di performance dipende dall’età. Per quell’esempio avevamo già calcolato 2=1-(VWG/VY)=0,7565: a conferma che è la spezzata di regressione (e nessun’altra funzione) l’ottima interpolante. La retta MQ è solo un second best. Vale la disequazione: Y*i=a+bXi (Yi-Y*i)2 215,13 9,80 215,13 8,23 215,13 0,02 218,17 0,03 218,17 3,33 221,22 10,36 221,22 7,74 224,26 18,16 224,26 3,02 227,30 2,88 220,00 6,357 2 2 0 Ryx yx 1 Il calcolo di R, passando dalla stima dei valori teorici e dagli scarti al quadrato (varianza residua) è però un po’ faticoso. Ma c’è una splendida sorpresa. Se la retta è stimata ai MQ (e solo in tal caso) senza alcun ulteriore vincolo si dimostra che il coefficiente di determinazione è esattamente pari al quadrato del coefficiente di correlazione lineare! R 2 yx xy 2 Nel nostro esempio: R2YX=(0,853)2 =0,728 Un esempio Un’analisi cross-section su due misure di pari opportunità (X=% donne che lavora, Y=disuguaglianza nei redditi) per 12 paesi europei mostra che se sale l’occupazione femminile cala la disuguaglianza (ma R2YX è bassa) regione X Y Italia 0,42 0,82 Portogallo 0,59 0,76 bYX=-(0,0095/0,0175)=-0,5428 Gran Bret. 0,65 0,74 aYX=0,61-(-0,5428x0,55)=0,91 Grecia 0,44 0,68 Spagna 0,32 0,67 Irlanda 0,39 0,67 Olanda 0,60 0,61 0,9 Austria 0,56 0,51 0,8 Belgio 0,60 0,50 Germania 0,53 0,50 Finlandia 0,72 0,45 Danimarca 0,78 0,42 TOTALE/N 0,55 0,61 E(X)=0,55; V(X)=0,0175; E(Y)=0,61; V(Y)=0,0169 Cov=-0,0095; XY=-(0,0095/0,0172)=-0,5523 R2YX=(XY)2 =0,305 (bassa) 0,7 0,6 0,5 0,4 0,3 0,4 0,5 0,6 0,7 0,8 Un secondo esempio: scomporre un miscuglio regione Distribuzione di 18 regioni italiane (Piemonte+Vald’Aosta e Abruzzi+Molise) secondo X=Divorzi per 100mila abitanti al 1988 e Y=coppie non coniugate per 1000coppie al 2001 60 50 40 30 20 10 0 Y XY+ Laz X+ Y+ Ven XY- X+ Y- Umb X 0 20 40 60 80 100 120 XY= 0,88 (ma se separassimo nord e sud, cosa troveremmo? Alla prossima lezione ..) X Y Piemonte 90 56 Lombardia 86 50 Trentino 71 50 Veneto 37 38 Friuli 53 54 Liguria 118 55 Emilia 97 60 Toscana 65 42 Umbria 48 26 Marche 36 27 Lazio 44 40 AbruzziMol 17 16 Campania 31 16 Puglie 26 17 Basilicata 25 9 Calabria 21 14 Sicilia 36 20 Sardegna 33 24 51,9 34,1 Media Scomporre un miscuglio / 2 Se separiamo le 8 regioni del Nord dalle 10 del Centro -Sud troviamo rette diverse con grado di adattamento assai più basso. E’ dunque la distinzione Nord/Sud a ‘fare la differenza’! 60 50 40 30 20 10 0 Italia Nord CSud E(X) 51,9 77,1 31,7 E(Y) 34,1 50,6 20,9 CovXY 420,11 123,44 59,57 V(X) 816,7 589,7 86,4 V(Y) 278,5 50,24 69,1 XY 0,88 0,717 0,771 bYX 0,514 0,209 0,6895 aYX 7,4 34,46 -0,956 R2YX 0,776 0,514 0,594 60 50 40 30 20 10 0 0 20 40 60 80 100 120 0 20 40 60 80 100 120 Reg V C Pie 176 52 VdA 149 82 Lom 138 50 Tre 106 50 Ven 136 38 Fri 187 54 Lig 241 56 Emi 192 60 Tos 192 42 Umb 186 26 Mar 169 27 Laz 130 40 Abr 147 18 Mol 148 11 Cam 77 16 Pug 95 17 Bas 119 9 Cal 102 14 Sic 99 20 Sar 116 24 Un terzo esempio: manipolare outliers Costruiamo il diagramma di dispersione delle venti regioni italiane in base a due indici di struttura al censimento della popolazione del 2001: V è l’indice di vecchiaia (Pop>64/ Pop<15%), C è la quota di coppie non coniugate sul totale delle coppie, per mille. Due osservazioni: (1) Il diagramma si addensa generalmente in un’area a forma di ellisse, che si definisce ‘nuvola di punti’. (2) Rispetto ai confini dell’ellisse alcuni casi assumono una coordinata anomala: si parla di ‘outliers’. 100 90 80 70 60 50 40 30 20 10 0 C Val d’Aosta Liguria V 50 75 100 125 150 175 200 225 250 Manipolare outliers/2 Cosa succede se escludiamo dall’analisi il dato anomalo della Val d’Aosta? rXY=0,526 R2YX=0,277 rXY= 0,593 R2YX= 0,352 bYX= 0,247; aYX= -3,032 bYX=0,252; aYX=-1,324 100 90 80 70 60 50 40 30 20 10 0 C Val d’Aosta Liguria V 50 75 100 125 150 175 200 225 250 100 90 80 70 60 50 40 30 20 10 0 C Liguria V 50 75 100 125 150 175 200 225 250 La retta ai MQ mantiene la stessa pendenza, ma si sposta un po’ più in alto Un quarto esempio: computer e cellulari X= numero di computer per 100 abitanti, Y=numero di cellulari per 100 abitanti, al 97 in 15 paesi europei. C’è correlazione tra i 2 fenomeni? Centro E. E.Mediter Nord E. Europa E(X) 25,83 11,25 34,00 24,67 E(Y) 14,17 16,25 35,00 21,67 CovXY 2,6945 15,9375 24,00 70,6886 V(X) 7,472 10,6875 6,40 85,556 V(Y) 5,806 30,1875 114,00 137,956 +0,409 +0,887 +0,888 +0,651 XY 50 45 40 35 30 25 20 15 10 5 0 Country X Y Austria 25 18 Belgio 25 12 Francia 23 12 Germania 23 13 Olanda 29 13 Svizzera 30 17 155 85 7 9 Italia 16 24 Portogallo 10 18 Spagna 12 14 45 65 Danimarca 35 31 Finlandia 35 46 Svezia 35 41 UK 29 16 Norvegia 36 41 170 175 TOT 370 325 24,67 21,67 Grecia TOT/N 0 5 10 15 20 25 30 35 40 Computer e cellulari/2 C’è, sì, correlazione tra i due fenomeni, ma la correlazione è assai diversa per i paesi del centro Europa, rispetto a quelli del sud e del nord. La covarianza tra computer e cellulari è quindi diversa nelle tre ripartizioni geografiche. Forse le ripartizioni geografiche influiscono, prima che sulle correlazioni, già sulle distribuzioni di frequenza di X e Y? Cellulari V(Y/geo) ngeo V(Y/geo)ngeo 5,806 6 34,836 Sud 30,1875 4 120,750 Nord 114,000 5 570,000 15 725,586 Centro VWG(Y) = 48,3724; VT(Y)=137,956 VWG(Y)/VT(Y)=0,351; 2YG=1-0,351=0,649 Abbiamo già le varianze vincolate delle tre ripartizioni geografiche (e la varianza generale) sia per X che per Y. Il calcolo di 2XG e 2YG ci dice che la varianza della diffusione dei computer è spiegata in misura altissima dal parametro geografico, mentre meno forte è la sua influenza sull’uso di cellulari. 50 45 40 35 30 25 20 15 10 5 0 Computer V(X/geo) ngeo V(X/geo)ngeo 7,472 6 44,832 Sud 10,6875 4 42,750 Nord 6,400 5 32,000 15 119,582 Centro VWG(X)=7,972; VT(X)=85,556 VWG(X)/VT(X)=0,093: 2XG=1-0,093=0,907 0 5 10 15 20 25 30 35 40 Computer e cellulari/3 Sia X il numero di computer e Y il numero di cellulari per 100 abitanti, al 1997, in 15 paesi europei. La retta stimata ai MQ che lega Y a X per l’intero continente è: Y=1,287+0,82X. Ma essa si scompone in tre diverse relazioni funzionali per Nord, Centro e Sud: 50 45 40 35 30 25 20 15 10 5 0 Centro E. E.Mediter Nord E. Europa E(X) 25,83 11,25 34,00 24,67 E(Y) 14,17 16,25 35,00 21,67 CovXY 2,6945 15,9375 24,00 70,6886 V(X) 7,472 10,6875 6,40 85,556 V(Y) 5,806 30,1875 114,00 137,956 XY +0,409 +0,8873 +0,888 +0,651 bXY +0,3606 +1,4912 +3,75 +0,8262 aXY +4,855 -0,526 -92,5 +1,287 R2XY 0,167 0,788 0,789 0,424 YX=0 4,85 -0,53 -92,5 1,29 YX=20 12,07 29,30 -17,5 17,81 YX=40 19,28 59,12 57,5 34,33 Y=-92,5+3,75X al Nord (R2=0,79) Y=+4,85+0,36X al Centro (R2=0,17) Y=-0,53+1,49X al Sud (R2=0,79) 0 5 10 15 20 25 30 35 40 NB: instabilità della relazione se V(X) è bassa Nei 5 paesi del Nord la relazione MQ trovata è 50 45 40 35 30 25 20 15 10 5 0 Y=-92,5+3,75X 24 28 32 36 40 La goodness of fit è alta (79% della varianza di Y è spiegata da X) ma qualcosa non quadra: la relazione è tutta ‘trainata’ dal caso inglese, che si differenzia dagli altri. Se si esclude il dato UK la prima cosa che colpisce è che la V(X) diventa piccolissima. E R2 diventa insignificante Country X Y Danimarca 35 31 Nord a 5 Nord a 4 E(X) 34,00 35,25 Finlandia 35 46 E(Y) 35,00 39,75 Svezia 35 41 CovXY 24,00 0,3125 UK 29 16 V(X) 6,40 0,1875 Norvegia 36 41 V(Y) 114,00 29,6875 bXY +3,75 +1,6667 aXY -92,5 -19,00 R2XY 0,789 0,0175!! Attenti: se la varianza dell’explanans X è molto piccola, diffidare delle stime MQ di una retta! Corollario 1: Minimi quadrati vincolati In alcuni casi i risultati della stima della retta sono sottoposti ad alcuni vincoli, legati alla specificità del fenomeno studiato. Per es. si può voler interpolare la nuvola di punti con una retta che passi per l’origine, dove quindi l’intercetta all’origine sia vincolata: aYX=0. In questo caso il coefficiente di regressione stimato (con il metodo dei minimi quadrati ‘vincolato’) è pari a: bYX mYX m2 X Per ricordarsi questa variante si noti come (non a caso) numeratore e denominatore sono i primi addendi rispettivamente del numeratore e denominatore della formula completa, espressa con le le formule operative di covYX e di varX) bYX covYX mYX mY m X var X m2 X ( m X ) 2 Naturalmente se la funzione non è stimata ai MQ o è stimata coi MQ vincolati la relazione R2YX=(YX)2 non sussiste e la bontà dell’adattamento va misurata attraverso la VarWR. Un esempio Su 5 contribuenti è stato rilevato il reddito procapite (X) in migliaia di euro, e il consumo per beni di base (Y) in centinaia di euro. Ecco i calcoli per la retta MQ: mX=3; mY=5; m2X=13,8; m2Y=28,6; VX=4,8; VY=3,6; mXY=18,2; covXY=+3,2. Quindi bYX=0,67; aYX=3; rYX=0,77; Y=3+0,67X. Se X=0 allora Y=3; se X=6 allora Y=5… Xi Yi Y i2 X i2 X iY i 1 3 9 1 3 1 5 25 1 5 3 3 9 9 9 3 6 36 9 18 7 8 64 49 56 3 5 28,6 13,8 18,2 Ma la retta interpolata ci dice una cosa curiosa: che con zero entrate c’è comunque un consumo di 300 euro. Non va mica bene.. 10 8 6 4 2 0 0 2 4 6 8 A noi interessa trovare una retta magari meno buona (aumenterà la varianza residua) ma che per redditi nulli abbia consumi nulli: insomma una retta che passi per l’origine. Essa avrà quindi intercetta aYX=0 e pendenza bYX=18,2/13,8=1,32. La retta Y=1,32X si impenna ora molto più brusca. Calcolate voi la varianza residua e confrontatela con quella della retta non vincolata. Corollario 2: Interpolante della linea di regressione Generalmente l’interpolante lineare ottima secondo il criterio dei MQ è ottenuta minimizzando la somma dei quadrati degli scarti tra tutte le osservazioni e le corrispondenti interpolanti teoriche. Ma si dimostra che: Si ottiene esattamente la stessa retta ai MQ minimizzando gli scostamenti quadratici tra le medie vincolate EY|xi e i rispettivi valori teorici. I due modi per determinare i parametri della retta ai MQ sono dunque equivalenti. Ma la varianza di Y calcolata tra medie vincolate Y|xi non potrà che essere inferiore (a volte molto inferiore!) alla varianza tra tutte le osservazioni Yj. Quindi: 2 Y 2 Y Y ,X cov Y , X Y X cov Y , X Y X Y , X a yx m y byx mx m y byx mx byx cov yx var x cov yx var x Attenzione quindi!! Interpolando la retta MQ intorno alla spezzata, va bene fidarsi dei parametri della retta, ma non del coefficiente di determinazione R2YX= (YX)2! Il solito esempio (con una variante) I soliti dieci atleti.. Xi Y Vi ni Xi ni YVini Xi2ni YVi2ni XiYVini 18 215 3 54 645 972 138675 11610 226 19 219 2 38 438 722 95922 8322 222 20 221 2 40 442 800 97682 8840 218 21 223 2 42 446 882 99458 9366 214 22 229 1 22 229 484 52441 5038 10 19,6 220 386 48417,8 4317,6 230 210 17 18 19 20 21 22 23 Torniamo ai dieci saltatori ma con una variante: I tre ragazzi di 18 anni saltavano – ricordiamo – rispettivamente 212, 215 e 218 cm: insomma c’era il più bravo e il meno bravo. Facciamo ora l’ipotesi che tutti e tre saltino 215 cm (cioè la media) e che quindi non ci sia variabilità entro la classe di età. E lo stesso facciamo per i 19enni e così via. Stimiamo la regressione MQ delle medie vincolate YVi delle performances al variare dell’età (è tra l’altro un buon esercizio di calcolo con modalità congiunte ponderate per le rispettive frequenze): otterremo una identica retta (bYX=160,35 aYX=3,04) ma adattamento molto più elevato (R2YX=0,958)!! ..e una controprova I soliti dieci atleti.. 230 226 222 218 214 210 17 18 19 20 21 22 23 I soliti dieci atleti ma più variabilità.. 230 Ma supponiamo che i dieci ragazzi abbiano la stessa performance media per età, ma tra quelli di pari età ci sia più variabilità: Il diagramma è più disperso. E la retta MQ? Xi Yi Y i2 X i2 X iY i 18 210 44100 324 3780 18 220 48400 324 3960 18 215 46225 324 3870 19 214 45796 361 4066 19 224 50176 361 4256 20 214 45796 400 4280 20 228 51984 400 4560 21 216 46656 441 4536 21 230 52900 441 4830 22 229 52441 484 5038 19,6 220 48447,4 386 4317,6 226 Si trova bYX=160,35; aYX=3,04 (la retta stimata è la stessa) ma R2YX=0,36 (l’adattamento peggiore)!! 222 218 214 210 17 18 19 20 21 22 23 Morale: a parità di spezzata di regressione (quindi di retta ai minimi quadrati) la goodness of fit può variare assai. Corollario 3: Stima da dati in forma di tabella Come già il coefficiente di correlazione, anche la retta ai MQ può essere calcolata a partire da una tabella a doppia entrata. Facciamo un esempio. Per 50 studenti conosciamo informazioni: il numero di componenti la famiglia (X) e il voto mediano (Y) ai temi in classe. Stimiamo la relazione lineare tra X e Y. Xi\Yj 0 1 2 3 4 n.j 5 4 4 2 0 0 10 6 4 6 4 2 0 16 7 2 4 4 4 2 16 8 0 2 2 2 2 8 ni. E(Y/x) 10 5,80 16 6,25 12 6,50 8 7,00 4 7,50 N=50 xi2 0 1 4 9 16 yi2 xi yi 33,64 0 39,06 6,25 42,25 13,00 49,00 21,00 56,25 30,00 I calcoli intermedi (effettuati analiticamente sull’intera distribuzione congiunta) sono: mX=1,60; mY=6,44; VX=1,44; VY=42,44; covXY=+0,58. I parametri stimati sono bYX=0,4 e aYX=5,8. Ma l’adattamento è basso: rXY=+0,074 e R2XY=0,0055. Se invece avessimo associato la dimensione familiare non ai voti di ciascuno studente ma alle sole medie vincolate (colonne cerchiate), e avessimo quindi stimato la retta MQ intorno alla spezzata di regressione, avremmo trovato la stessa retta, ma con goodness of fit ben diversa: VE(Y(X)=0,234; rXE(Y/X)=+0,991; R2XE(Y/X)=0,982

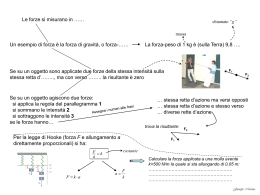

Scarica